3월 24일에 발표된 새로운 연구 방사선과북미 방사선학회(RSNA) 저널에 따르면 방사선 전문의와 다중 모드 대형 언어 모델(LLM) 모두 인공 지능(AI)이 생성한 “딥페이크” 이미지와 실제 X선을 구별하는 데 어려움을 겪고 있음을 보여줍니다. 이번 연구 결과는 합성 의료 이미지로 인한 위험에 대한 우려를 제기하고 의료 이미지의 정확성을 보호하고 의료 전문가가 딥페이크를 인식할 수 있도록 준비하는 데 도움이 되는 더 나은 도구와 교육의 필요성을 강조합니다.

“딥페이크”는 실제처럼 보이지만 AI를 사용하여 생성되거나 변경된 비디오, 사진, 이미지 또는 오디오 파일입니다.

“우리 연구는 이러한 딥페이크 엑스레이가 가장 고도로 훈련된 의료 영상 전문가인 방사선 전문의를 속일 수 있을 만큼 현실적이라는 것을 보여줍니다. AI 생성 이미지가 존재한다는 것을 알고 있었음에도 불구하고 말입니다.”라고 뉴욕 마운트 시나이 의과대학의 박사후 연구원인 Mickael Tordjman 박사는 말했습니다. “예를 들어 조작된 골절이 실제 골절과 구별할 수 없는 경우 이는 사기 소송에 대한 높은 위험 취약성을 만듭니다. 또한 해커가 병원 네트워크에 액세스하여 합성 이미지를 주입하여 환자 진단을 조작하거나 디지털 의료 기록의 근본적인 신뢰성을 약화시켜 광범위한 임상 혼란을 야기하는 경우 상당한 사이버 보안 위험이 있습니다.”

연구 세부 사항 및 이미지 테스트

연구에는 6개국(미국, 프랑스, 독일, 터키, 영국, 아랍에미리트) 12개 기관의 방사선 전문의 17명이 포함되었습니다. 이들의 경험은 초보자부터 실무 경력이 최대 40년인 전문가까지 다양했습니다. 이 연구에서는 총 264개의 X선 이미지를 검사했으며, 실제 스캔과 AI 생성 이미지를 균등하게 분할했습니다.

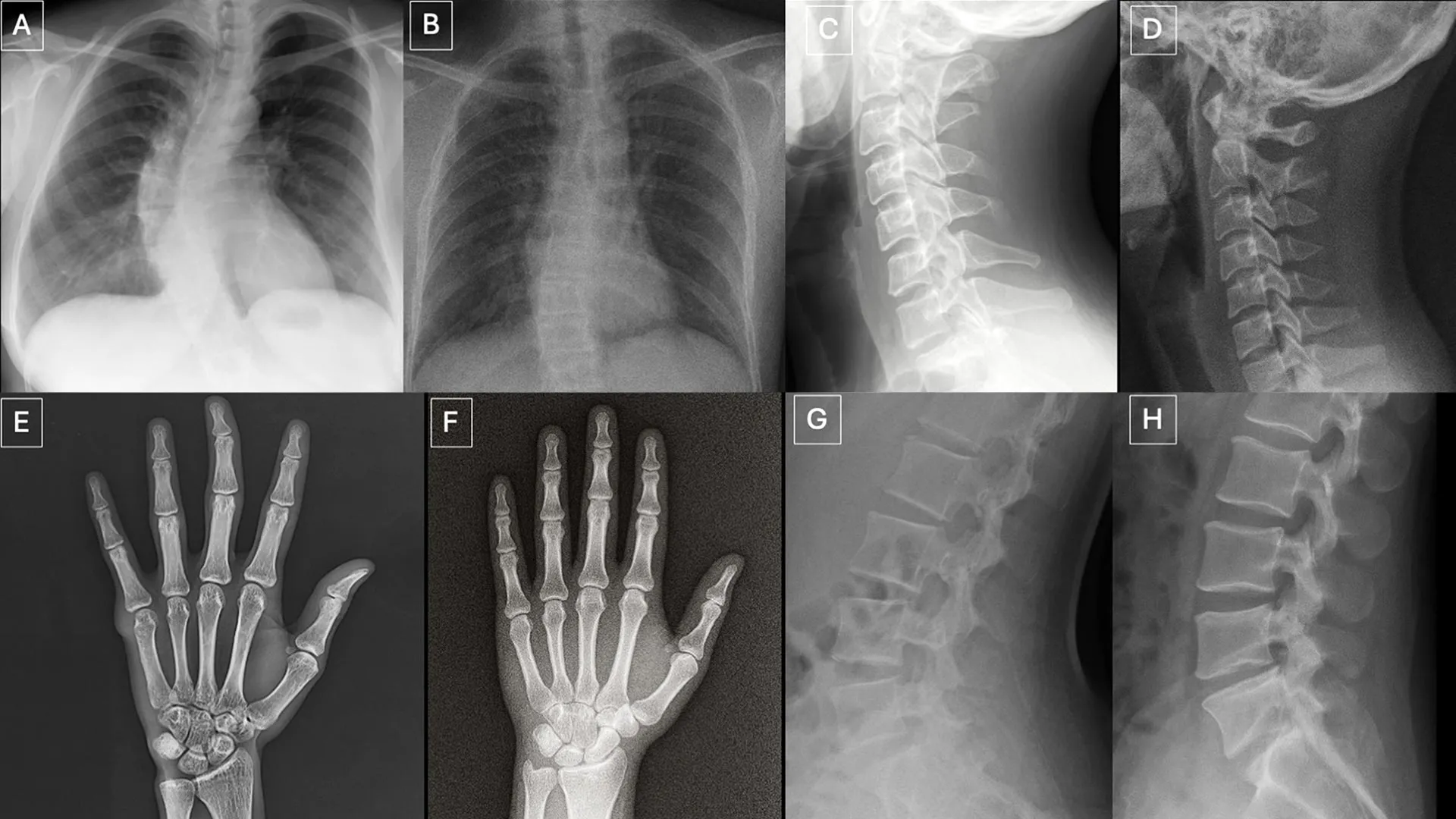

참가자들은 겹치지 않는 두 개의 개별 이미지 세트를 검토했습니다. 한 세트에는 실제 이미지와 신체의 여러 부분에서 ChatGPT로 생성된 엑스레이가 혼합되어 있습니다. 두 번째 세트는 흉부 엑스레이에 초점을 맞췄습니다. 절반은 실제이고 나머지 절반은 Stanford Medicine 연구원이 개발한 오픈 소스 생성 AI 확산 모델인 RoentGen을 사용하여 생성되었습니다.

방사선 전문의와 AI를 위한 감지 정확도

방사선 전문의에게 가짜 이미지가 포함되어 있다는 사실을 알리지 않았을 때 기술적 품질을 평가한 후 AI가 생성한 엑스레이를 인식한 비율은 41%에 불과했습니다. 합성 이미지가 존재한다는 사실을 알게 된 후, 진짜와 가짜를 구별하는 평균 정확도는 75%로 증가했습니다.

성과는 개인마다 매우 다양했습니다. 방사선 전문의는 ChatGPT에서 생성된 이미지의 58%~92%를 정확하게 식별했습니다. AI 시스템도 비슷한 한계를 보였다. 4개의 다중 모드 LLM(GPT-4o(OpenAI), GPT-5(OpenAI), Gemini 2.5 Pro(Google) 및 Llama 4 Maverick(Meta))은 57%~85% 범위의 정확도를 달성했습니다. 딥페이크 이미지를 생성하는 데 사용된 ChatGPT-4o도 다른 모델보다 성능이 좋았지만 모두 감지하지는 못했습니다.

RoentGen이 생성한 흉부 엑스레이의 경우 방사선 전문의는 62%~78%의 정확도를 달성한 반면, AI 모델은 52%~89%의 정확도를 달성했습니다.

경험이 탐지를 보장하지 않음

이 연구에서는 방사선 전문의의 수년간의 경험과 가짜 엑스레이를 식별하는 능력 사이에 연관성이 없음을 발견했습니다. 그러나 근골격계 방사선 전문의는 다른 하위 전문의보다 훨씬 더 나은 성과를 거두었습니다.

Deepfake X-Ray의 시각적 단서

연구자들은 합성 이미지에 나타날 수 있는 몇 가지 패턴을 식별했습니다.

Tordjman 박사는 “딥페이크 의료 이미지는 종종 너무 완벽해 보입니다.”라고 말했습니다. “뼈는 지나치게 매끄러우며, 척추는 부자연스러울 정도로 똑바르고, 폐는 지나치게 대칭적이며, 혈관 패턴은 지나치게 균일하며, 골절은 비정상적으로 깨끗하고 일정하게 나타나며 종종 뼈의 한쪽에만 국한됩니다.”

의료 영상의 위험 및 보호 장치

결과는 딥페이크 엑스레이가 오용될 경우 심각한 위험을 강조합니다. 조작된 이미지는 법적 소송에 사용되거나 병원 시스템에 삽입되어 진단에 영향을 주고 치료를 방해할 수 있습니다.

이러한 위협을 줄이기 위해 연구원들은 더 강력한 디지털 보호를 권장합니다. 여기에는 이미지에 직접 삽입된 보이지 않는 워터마크와 이미지 캡처 시 기술자에게 연결된 암호화 서명이 포함되어 진위 여부를 확인하는 데 도움이 됩니다.

의료 영상 분야 AI의 미래

Tordjman 박사는 “우리는 잠재적으로 빙산의 일각만을 보고 있습니다.”라고 말했습니다. “이 진화의 논리적인 다음 단계는 CT 및 MRI와 같은 합성 3D 이미지의 AI 생성입니다. 이제 교육 데이터 세트 및 감지 도구를 구축하는 것이 중요합니다.”

교육과 인식을 지원하기 위해 연구원들은 교육 목적의 대화형 퀴즈가 포함된 엄선된 딥페이크 데이터세트를 출시했습니다.

출처: https://www.sciencedaily.com/releases/2026/03/260326011452.htm